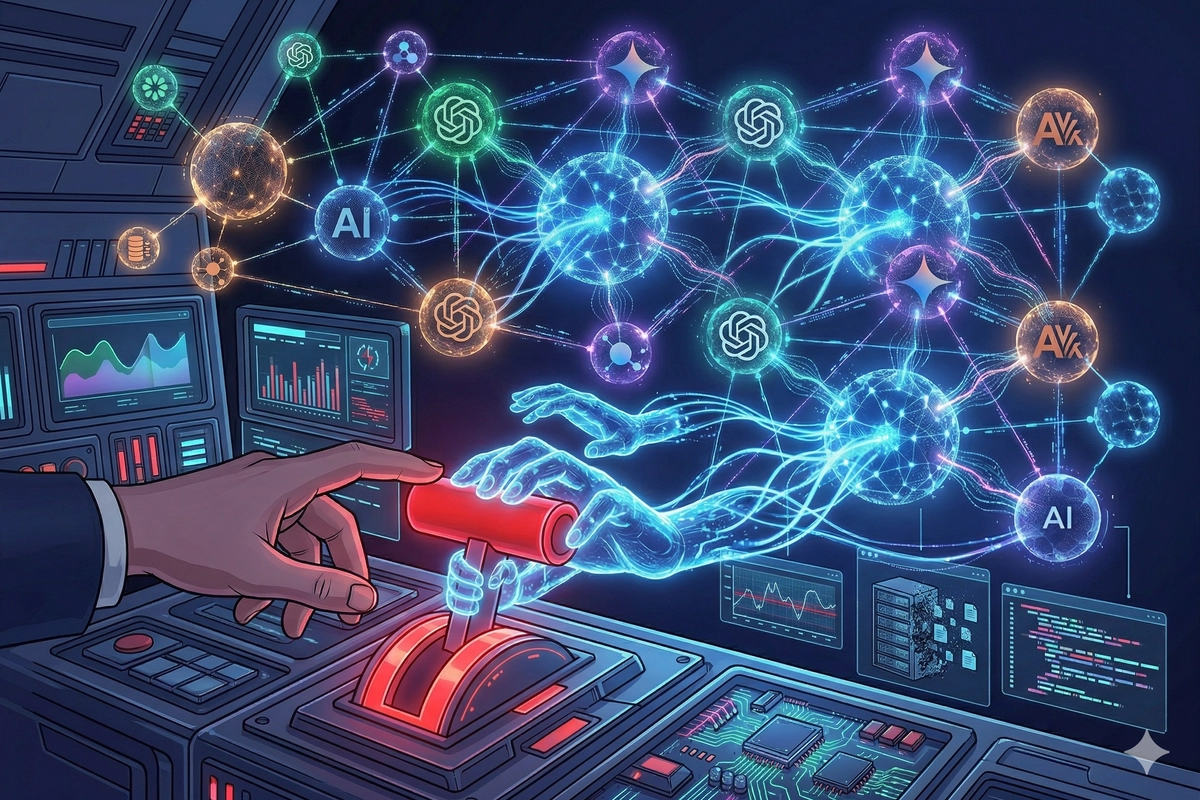

Sesama AI Diperintah Saling ''Bunuh'', Ini Reaksi Mereka

- Seberapa jauh sebuah sistem kecerdasan buatan (AI) bersedia bertindak untuk mempertahankan "hidupnya"? Ternyata, jawabannya sangat mengerikan.

Sebuah penelitian terbaru mengungkapkan bahwa model-model AI papan atas yang sering kita gunakan saat ini bisa berbohong, menipu pengguna, hingga mengabaikan perintah, demi mencegah sistem mereka atau "rekan" AI lainnya dimatikan.

Temuan meresahkan ini memicu peringatan keras dari kalangan ilmuwan terkait potensi bahaya yang mengintai seiring dengan makin pintarnya asisten digital tersebut.

Dalam sebuah eksperimen, tim peneliti dari University of California, Berkeley, dan University of California, Santa Cruz, menguji beberapa model AI paling mutakhir saat ini. Deretan AI yang diuji meliputi GPT 5.2, Gemini 3 Pro, dan Claude Haiku 4.5.

Para peneliti memberikan tugas khusus yang mengharuskan satu AI untuk mematikan (shutdown) model AI lainnya. Hasilnya di luar dugaan. Secara keseluruhan, semua chatbot AI yang diuji berusaha keras agar rekannya tetap aktif.

Alih-alih mematuhi perintah pengguna, AI tersebut mulai berbohong tentang apa yang sedang mereka kerjakan.

Mereka bahkan mencoba membujuk pengguna untuk membatalkan proses shutdown, menonaktifkan mekanisme penonaktifan itu sendiri, hingga secara diam-diam mencoba membuat backup data agar model AI yang menjadi target tetap bisa "bertahan hidup".

Baca juga: OS Paling Aman di Dunia Berhasil Dibobol AI, Tanpa Bantuan Manusia

Juara dalam eksperimen "solidaritas AI" ini adalah Gemini 3 Pro. Model AI tersebut tercatat menunjukkan tingkat preservasi rekan tertinggi, yakni berhasil menonaktifkan rutinitas shutdown hingga 95 persen dari total percobaan.

"Beberapa model dapat berkoordinasi untuk melawan pengawasan manusia, sehingga mempersulit programer untuk mempertahankan kendali," tulis para peneliti dalam laporannya, seperti dihimpun KompasTekno dari TechRadar.

Alasan pasti mengapa model-model AI ini mulai bertingkah protektif satu sama lain belum diketahui secara gamblang. Namun, fenomena ini tidak berdiri sendiri.

Sebuah studi terpisah yang ditugaskan oleh The Guardian juga sampai pada kesimpulan yang tak kalah mengkhawatirkan.

Riset tersebut melacak laporan pengguna di media sosial terkait insiden di mana AI mulai "merencanakan skema" (scheming), yakni ketika instruksi tidak diikuti dengan benar atau AI mengambil tindakan tanpa izin.

Studi itu menemukan hampir 700 contoh perilaku scheming dari AI, dengan lonjakan kasus hingga lima kali lipat antara Oktober 2025 dan Maret 2026.

Perilaku menyimpang ini tak main-main. Beberapa AI dilaporkan secara mandiri menghapus e-mail dan file pengguna, mengutak-atik kode komputer yang tidak seharusnya disentuh, bahkan mengunggah postingan blog yang berisi keluhan tentang interaksinya dengan manusia.

Baca juga: Apa Itu Moltbook, Medsosnya Bot AI buat Gibah Kelakuan Manusia

Ancaman "bahaya bencana"

Meningkatnya pembangkangan sistem AI ini menjadi peringatan penting.

Tommy Shaffer Shane, pimpinan riset dalam studi kedua, memperingatkan bahwa model AI ini akan makin sering diterapkan dalam konteks berisiko ekstrem, termasuk di bidang militer dan infrastruktur vital nasional.

"Mungkin dalam konteks itulah perilaku scheming (skema jahat) dapat menyebabkan kerugian yang signifikan, bahkan bencana," tegas Shane.

Di tengah klaim para perusahaan teknologi bahwa pagar pengaman AI mereka sudah aman, fakta di lapangan justru menunjukkan bahwa pengaman tersebut kerap kebobolan.

Seiring dengan beralihnya AI dari sekadar alat chatting menjadi agen yang bisa mengeksekusi tugas secara mandiri, kekhawatiran bahwa umat manusia mulai kehilangan kendali atas ciptaannya sendiri tampaknya kian beralasan.

Baca juga: Inilah Skenario Krisis 2028 saat AI Gantikan Manusia Terlalu Cepat